Détection et suivi d’un objet en mouvement à l’aide de l’Arduino et Webcam

La détection et le suivi d'un objet en mouvement est un phénomène de vision par ordinateur permettant de localiser et suivre un objet spécifique au sein d'une séquence vidéo en temps réel. Ce procédé combine plusieurs étapes clés : détection de l'objet, suivi continu, prédiction de mouvement, et analyse des changements d'emplacement de l'objet au fil du temps. Voici un aperçu détaillé des principes impliqués dans ce phénomène :

1. Détection de l'objet

La première étape consiste à détecter l'objet à suivre. Cette détection peut se faire de différentes manières, en fonction des caractéristiques visuelles de l'objet :

Détection par couleur : Si l'objet possède une couleur distinctive, on peut utiliser une segmentation en couleurs (par exemple, dans l'espace de couleur HSV) pour isoler cette couleur spécifique.

Détection par caractéristiques : Lorsque la couleur n'est pas suffisante, on peut utiliser des caractéristiques comme les contours, les formes, ou des points d'intérêt spécifiques de l'objet (par exemple, avec des algorithmes comme SIFT, SURF ou ORB).

Détection par modèle ou apprentissage : Dans certains cas, des modèles de détection préalablement entraînés (basés sur des réseaux de neurones convolutionnels) sont utilisés pour reconnaître l'objet au sein d'une scène plus complexe.

2. Suivi de l'objet

Une fois l'objet détecté, l’étape de suivi permet de maintenir sa position à travers les différentes images de la séquence vidéo. Plusieurs méthodes sont couramment utilisées :

Méthodes de suivi basées sur les fenêtres glissantes : On applique une région autour de l'objet détecté pour suivre son mouvement dans l'image suivante en cherchant des similarités de pixels ou de caractéristiques.

Algorithme de CamShift (Continuously Adaptive Mean Shift) : Adaptation du Mean Shift, cet algorithme ajuste dynamiquement la fenêtre de suivi en fonction de la forme et de la taille de l'objet pour un suivi plus robuste.

Filtres de Kalman : Ces filtres permettent de prédire la position de l'objet dans les images suivantes en fonction de son déplacement précédent, aidant à stabiliser le suivi même en cas de perte temporaire de la détection.

Deep Learning et réseaux neuronaux récurrents : Dans les applications avancées, des réseaux de neurones récurrents (comme les LSTM) ou des réseaux de neurones profonds sont utilisés pour un suivi plus précis et intelligent en tenant compte du contexte environnant.

3. Prédiction de mouvement

En utilisant les positions précédentes de l'objet, des algorithmes peuvent prédire son mouvement futur. Cela est particulièrement utile pour anticiper la trajectoire de l'objet lorsqu’il se déplace rapidement ou sort momentanément de la vue de la caméra. Par exemple :

Filtre de Kalman : Utilisé pour estimer la position future d'un objet basé sur des modèles de mouvement linéaire et non-linéaire.

Modèle de mouvement : Des hypothèses sur la vitesse et la direction de l'objet peuvent être faites, permettant de prédire où il se situera dans l'image suivante.

4. Mise à jour et recapture (Re-Detection)

Dans les systèmes de suivi robustes, si l'objet sort du champ de vision ou si le suivi est perdu, un mécanisme de "re-détection" peut être utilisé pour le retrouver lorsqu'il revient dans la scène. Cette étape peut inclure :

Mise à jour des caractéristiques visuelles : L'apparence de l'objet peut changer au fil du temps, surtout dans des environnements dynamiques. Des techniques de mise à jour sont appliquées pour ajuster les caractéristiques du modèle de suivi.

Mémoire à court terme : Certaines approches de suivi conservent une mémoire des dernières positions de l'objet pour essayer de le retrouver plus efficacement.

Applications de la détection et du suivi d'objets en mouvement

Surveillance vidéo : Suivi des personnes ou des objets dans les systèmes de sécurité.

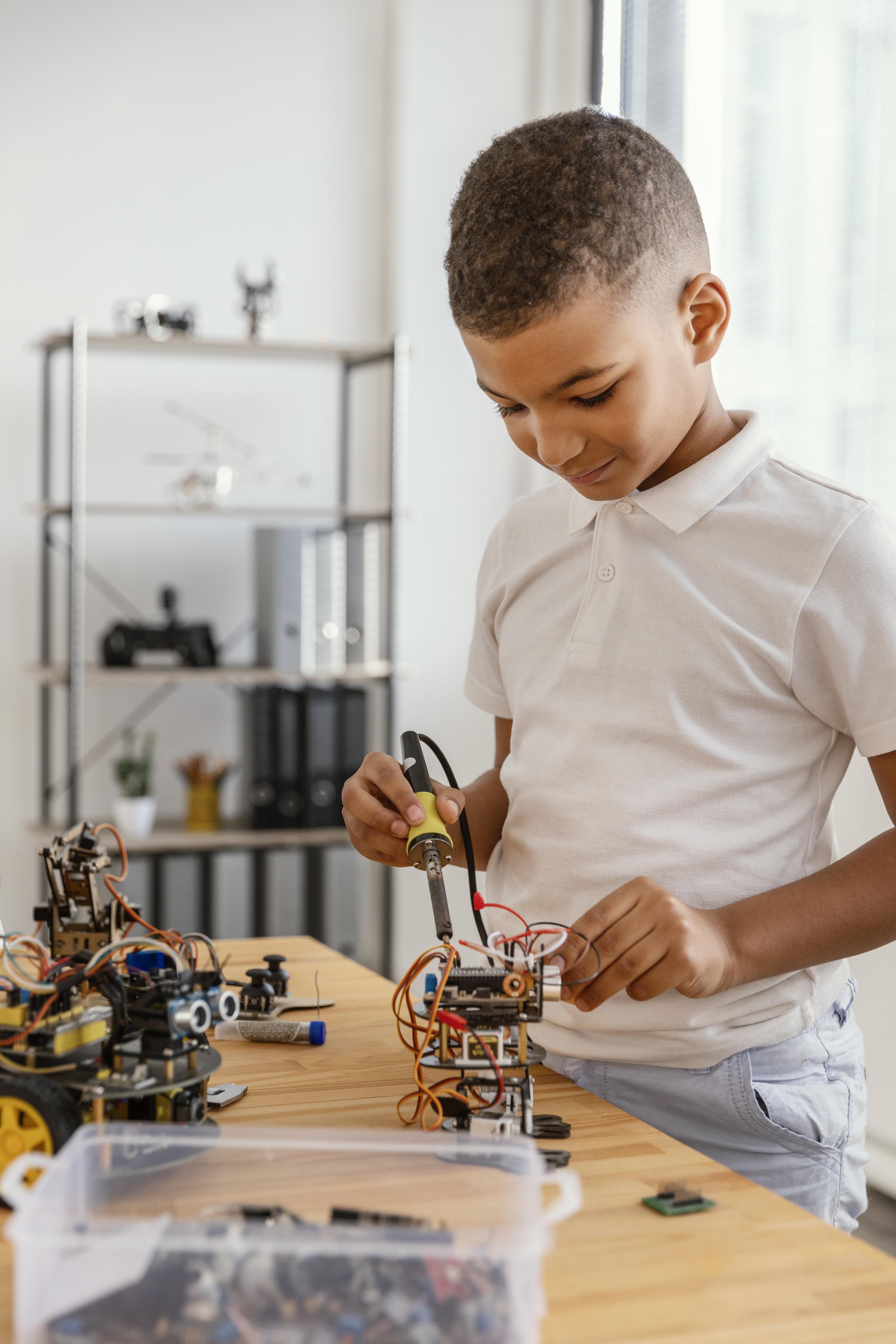

Robotique : Aide les robots mobiles à suivre des objets ou des personnes dans leur environnement.

Véhicules autonomes : Permet de détecter et de suivre d'autres véhicules ou piétons pour assurer la sécurité.

Analyse sportive : Utilisée pour suivre les mouvements des joueurs ou de la balle dans les enregistrements sportifs.

Le suivi en temps réel est donc un processus itératif et dynamique qui nécessite l'ajustement constant des paramètres pour s'adapter aux changements dans l’apparence et la position de l'objet à travers la séquence vidéo.

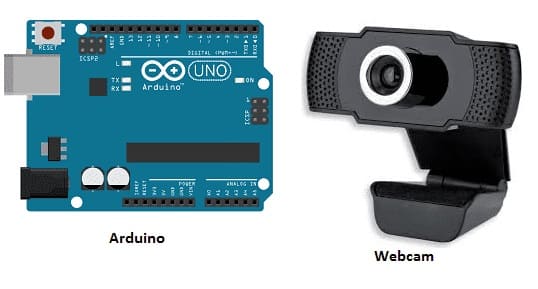

L’Arduino seul ne peut pas gérer la détection et le suivi d’un objet en mouvement car il manque de puissance de traitement pour analyser des flux vidéo. Cependant, une solution courante consiste à utiliser un ordinateur pour effectuer le traitement vidéo en temps réel et communiquer les informations de suivi à l’Arduino pour contrôler des dispositifs physiques (comme des servomoteurs ou des LEDs) en fonction de la position ou de la détection d'un objet.

Voici comment mettre en place un système de détection et de suivi d'objet à l’aide d’une webcam, d’un ordinateur pour le traitement de l’image avec Python (OpenCV), et de l’Arduino UNO pour exécuter des actions basées sur les informations reçues.

Matériel nécessaire

Arduino UNO (ou similaire) pour contrôler des périphériques en fonction de la détection.

Webcam pour capturer le flux vidéo.

Ordinateur pour le traitement de l'image.

Python et bibliothèques OpenCV et PySerial (pour la communication Arduino).

USB pour connecter l’Arduino à l’ordinateur.

1 commentaire

Michée MPIA 22-03-2525

Salut ! Vous pouvez m'aider d'avoir ce code ? J'en ai vraiment besoin urgemment. Et si possible , je peux passer à une séance de cours en ligne pour ce tutoriel ?

laisser un commentaire

Tutoriels récents

Tutoriels populaires

Tutoriels plus commentés